De nos jours, on l'utilise tous les jours, il fait partie de nos vies quotidiennes, mais pourtant, les contours de ce concept sont parfois bien trop flous. Et oui, c'est bien l'informatique, entre processeur, systèmes d information et développeur. Le mot informatique a été créé en 1962 par Philippe Dreyfus. C'est un néologisme de la langue française créé à partir des mots "information" et "automatique". Un terme pas si ancien, pour un mot désormais si largement partagé ! Des calculs de l'antiquité à la commercialisation du premier ordinateur en 1951, l'UNIAC, en passant par la sortie du PC d'IBM en 1981 jusqu'au lancement de Windows 95, la vraie question est : comment en est-on arrivé là ?

Jérôme Chailloux disait : "Le web est l'invention la plus utile à l'humanité depuis sa pire invention : la bombe atomique."

Le monde a basculé d'une ère industrielle à un âge numérique. Mais Rome ne s'est pas construite en un jour, bien évidemment : l'informatique tel qu'on le connaît aujourd'hui s'est construit sur de nombreuses années et grâce à de nombreux mathématiciens, physiciens et théoriciens. Découvrez tout dans notre cours informatique en ligne !

Histoire de l'informatique : De l'algorithme à la notion de programme

Le but final de l'informatique est d'évacuer la pensée du calcul afin de le rendre exécutable par une machine qui est fabuleusement rapide et exact mais totalement dénuée de pensée.

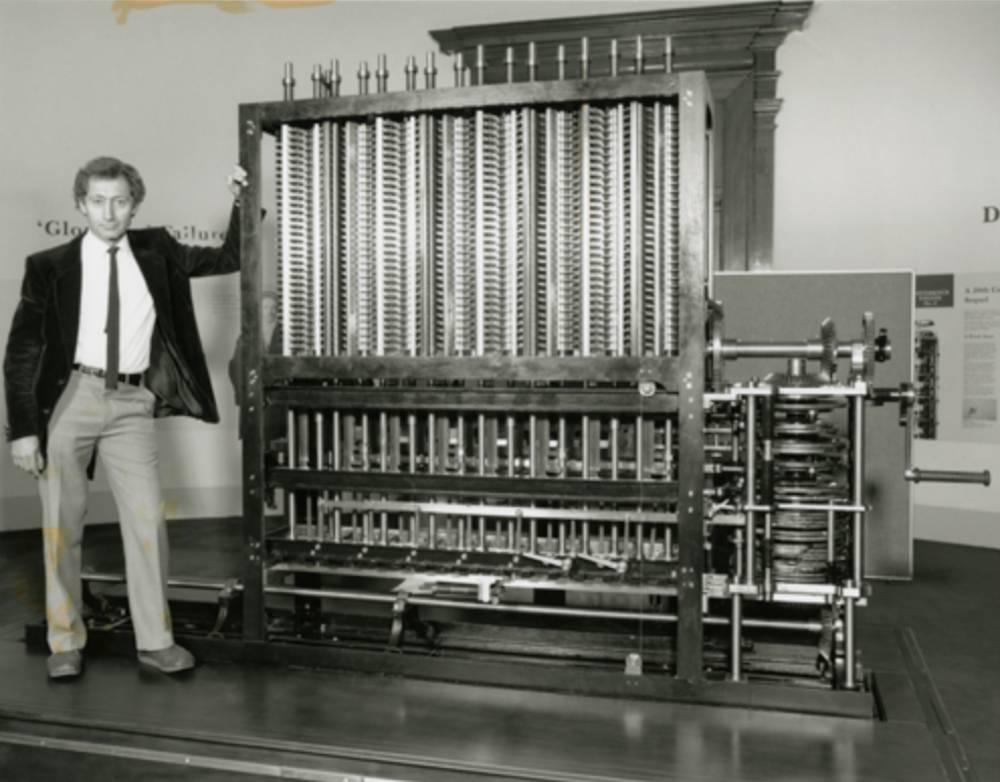

Le calcul binaire est apparu en Europe vers 1697, grâce aux travaux de Leibniz. L'idée est de savoir comment passer d'un nombre binaire au suivant, en éclairant le calcul avec les puissances successives. C'est à partir de ce calcul binaire que seront également développés les premiers ordinateurs, et donnera le champ à d'autres penseurs. Par exemple, Ada Lovelace, mathématicienne du 19ème siècle, a publié ses recherches en 1840, sous un nom masculin. Elle a fortement contribué à la création du premier ordinateur appelé la machine analytique par Charles Babbage. La machine analytique avait pour but d'exécuter tout ce que les hommes lui demanderaient d'effectuer : opérations numériques et symboliques. Un vrai précepte d'ordinateur, balbutiant mais bien présent !

L'informatique au fil des ans : De la mécanisation des calculs au logiciel

L'homme a d'abord su fabriquer des outils puis des machines, c'est-à-dire des objets qui utilisent une force autre que la sienne et qui peuvent exécuter de manière autonome certaines opérations, même complexes et programmées comme le métier à tisser de Jacquard en 1801. C'est la première programmation binaire. Mais la machine mécanique ne sait pas se modifier elle-même, il faut l'aider un petit peu ! Au contraire, l'ordinateur, machine à informations, sait modifier son propre programme et devient une machine universelle. Elle permet de maîtriser l'intelligence mécanique, ce qui changera beaucoup de choses, jusqu'à nos comportements aujourd'hui au quotidien ! Alan Turing a créé en 1936 l'article fondateur de la science informatique. Il a compris comment quelques opérations élémentaires de calcul étaient universelles. Elles pouvaient être combinées pour exécuter tous les algorithmes du monde, donnant le coup d'envoi à la création des calculateurs universels programmables. C'est eux que l'on appellera plus tard très sobrement : des ordinateurs ! C'est lui qui a fait basculer le monde de l'ère industrielle à l'âge du numérique, puisqu'il s'agissait de calculer de façon programmée au moyen d'un tableau de connexion. Un concept qui ne nous est pas étranger aujourd'hui encore !

Pour la petite histoire, les britanniques avaient mis la main sur une de ces machines mais impossible de savoir comment elle fonctionnait. Le code a été cassé dès 1933 par des mathématiciens polonais mais le calcul durait trop longtemps, il fallait plusieurs jours pour pouvoir déchiffrer le message alors que les nazis changeaient le code quotidiennement.

Je vous conseille d'ailleurs le film Imitation Game qui retrace l'histoire d'Alan Turing et de la machine Enigma. Même si le film est bien sûr romancé, il reste très intéressant pour comprendre les enjeux de l'époque et certaines questions qui demeurent sans réponse. Aujourd'hui, les choses se sont bien éclairées, mais aussi et surtout : étoffées. Une autre femme d'exception a contribué à l'essor de l'information. En effet, Grace Hopper a travaillé sur le premier ordinateur numérique entièrement automatique d'IBM : le Harvard Mark I.

Petite anecdote sur le Mark I en 1947 : un jour le calculateur tomba en panne. On y trouva un papillon de nuit coincé dans le circuit relais. L'insecte fut ôté avec soin et placé dans le journal de bord avec la mention : "First actual case of bug being found". C'est de là que vient l'expression bug informatique. A cette époque, il s'agissait réellement d'insectes !

Ces premiers ordinateurs n'étaient pas utilisables à grande échelle mais seulement réservés à un usage très professionnel. C'est Grace Hopper qui a défendu l'idée qu'un langage informatique devait pouvoir être écrit dans un langage proche de l'anglais. Elle conçoit alors un compilateur, un logiciel qui permet de traduire en langage machine les éléments de l'algorithme et donc compréhensible par tous les ingénieurs.

L'évolution informatique : du codage de l'information à l'objet numérique

Shannon a défini la quantité d'informations de manière mathématique avec la théorie des probabilités qu'a mis en équation Kolmogorov. Cette théorie se base sur l'hypothèse que l'on peut quantifier du contenu informatif groupés (plusieurs messages donc), que le codage en informatique permettrait de distribuer de manière claire et stable.

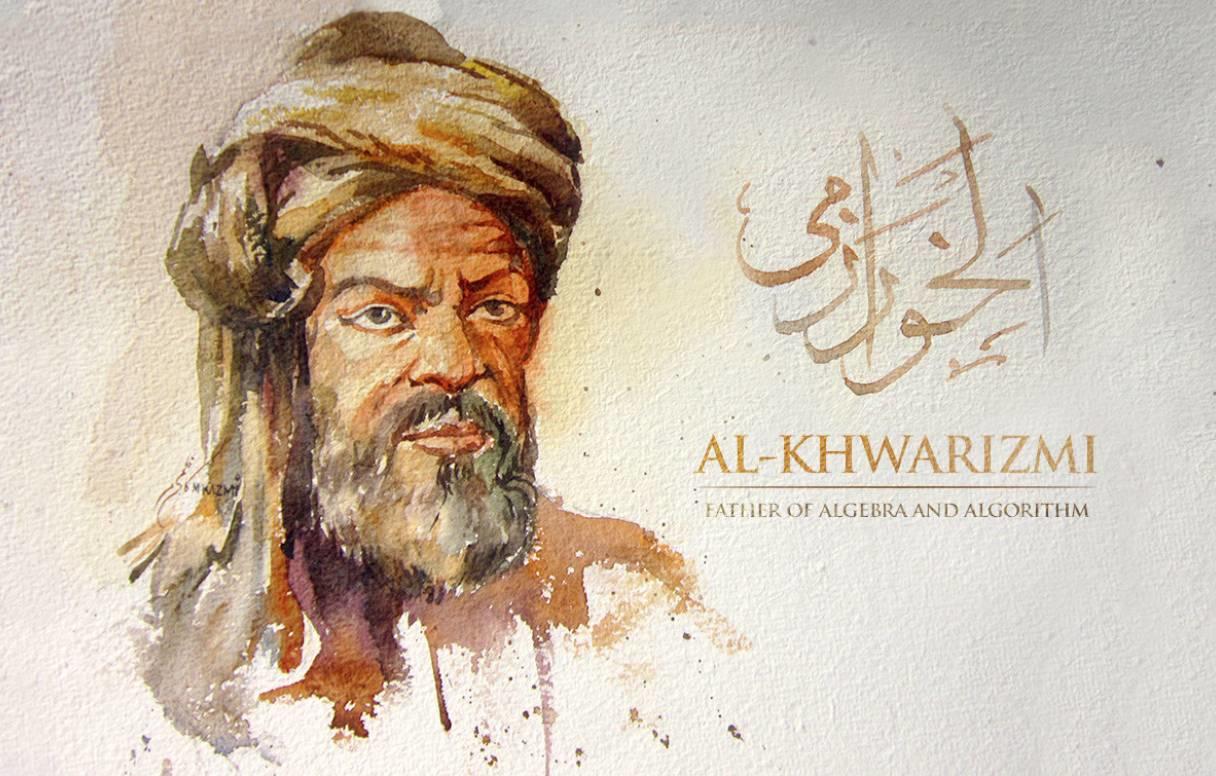

Avec ceci, ils ont tout simplement permis de changer la vision du monde dans les échanges numériques. Petit à petit, l'oiseau a fait son nid, et a permis de modifier radicalement nos comportements aujourd'hui. Tous les objets (images, sons, textes, données) ont alors un reflet numérique qui permet de mémoriser l'information, de la transmettre, de la reproduire à l'infini et de la manipuler de manière spécifique grâce à toutes sortes d'algorithmes. Ces algorithmes sont alors la base de l'informatique telle que l'on va la connaître. Rose Dieng-Kuntz a quant à elle aidé à construite le web sémantique (fait-elle partie des 10 meilleurs codeurs de l'histoire ?) qui désigne un ensemble de technologies visant à rendre l'information du web accessible et utilisable par tous les programmes logiciels et par l'homme grâce à un système de métadonnées. Elle a aussi beaucoup travaillé sur la gestion des connaissances. Première femme africaine à être admise à Polytechnique en 1976, elle s'est spécialisée en intelligence artificielle, et aujourd'hui, on peut tous s'accorder à lui dire un grand merci. Une visionnaire, doublée d'un esprit brillant ! Par exemple, si l'on tape "accident de véhicule" dans un moteur de recherche, il va en fait rechercher tous les documents dans lesquels "accident" et "véhicule" apparaissent. Mais si le document mentionne "collision entre un camion et un vélo" sans mentionner "accident de véhicule" précisément, il ne ressortira pas. L'idée du web sémantique est justement que ce document ressorte également. Brillant, on vous dit !

Notre monde numérique aujourd'hui : l'évolution de l'interface homme-machine

Au début du 21ème siècle, les interfaces entre les ordinateurs et les cerveaux n'en étaient qu'à leurs balbutiements. Mais tout cela va bien sûr évoluer jusqu'au meilleur. Nous devons l'interface utilisateur à Xerox au Palo Alto Research Center à une époque où les PC n'existaient pas encore. En 1968, profitant du développement de la télévision couleur, Douglas Engelbart présente un environnement graphique avec des fenêtres que l'on peut ouvrir et fermer à l'aide d'un pointeur relié à l'ordinateur : la souris. Véritable visionnaire, il met en place ce qui lui vaudra notamment en 2000 la médaille nationale de la technologie. Avec son groupe, avec qui il avait d'ailleurs fondé Arpanet, l'ancêtre d'internet, il créé donc une boîte faite de bois, et accompagnée de deux roues en métal. On est bien loin des souris à lecture optique contemporaine. Mais comme il faut passer par des débuts, le premier modèle était officialisée en 1970, la souris d'ordinateur était née ! Entre 1969 et 1983, l'interface homme-machine est minimale : le clavier sert à envoyer de l'information retranscrite par l'écran. Les ordinateurs sont à l'époque réservés à des élites et uniquement présents dans le milieu professionnel. L'information et les données que l'on traitait étaient majoritairement faites de texte, ce qui a longuement défini l'agencement du clavier selon les pays. Entre 1984 et aujourd'hui, après les avancées techniques, le confort de l'utilisateur entre en jeu. Le contenu à l'écran est présenté sous la forme "What You See Is What You Get" (WYSIWYG). Cette expression est popularisée par Apple et son fameux Macintosh, sur lequel on reviendra. L'interaction devient symbolique avec les fenêtres, les icônes, les menus et les dispositifs de pointage et l'apprentissage est facilité pour le grand public. C'est la naissance de l'informatique grand public. Mais justement, comment ce dernier s'est-il formé exactement ces dernières années ?

L'informatique dans les années 1990

Informatique : Alliance d’un science inexacte et d’une activité humaine faillible - Luc Fayard De Luc Fayard

Les années 1990 marquent un tournant bien plus contemporain dans ce que l'informatique implique dans nos vies. En effet, le concept de "poste de travail" devient plus concret, et s'installe dans les différents milieux sociaux. Tout un chacun va alors avoir accès aux joies, mais aussi aux méandres de l'informatique. De cette manière, le stockage ou les partages de données deviennent plus importants, et se lient intimement à la vie privée. Nos comportements se sont progressivement adaptés aux innovations informatiques des années 1990. Le petit supplément d'âme ? L'avènement d'internet, qui devient accessible au plus grand public. Au programme : courrier électronique (mail), transfert de fichiers, etc. C'est de cette manière que l'adresse IP (Internet Protocol) devient importante. De façon logique, si on part du principe qu'une société s'imprègne des créations nouvelles, certaines professions vont se créer, ou encore se renouveler. Parmi ces professions qui se retrouvent impactées, on retrouve :

- Les ressources humaines,

- Le commerce,

- La communication,

- La documentation,

- La banque (grâce à la carte à puce),

- La billetterie,

- Et bien d'autres encore !

Symboliquement, en 1998, Apple commercialise l'iMac G3, qui révolutionnera, contrairement aux apparences, leur univers informatique. On l'aura compris, des réseaux informatiques au microprocesseur, en passant par les télécommunications, l'informatique des années 1990 est un vrai tournant ! Comment trouver un cours informatique senior ?

L'informatique dans les années 2000

La révolution informatique fait gagner un temps fou aux hommes, mais ils le passent avec leur ordinateur ! - Khalil Assala De Khalil Assala

Le virage des années 2000 marque un changement radical dans la consommation de l'informatique, puisque ce dernier s'installe dans le quotidien véritable de tout un chacun, et ce, de plus en plus. La domestication des ordinateurs se mène grâce au développement d'internet. Il s'installe dans les tâches quotidiennes, notamment lorsqu'il s'agit de gérer les comptes ou la facturation des biens domestiques. Le symbole principal ? Le développement de l'ordinateur portable, qui se généralise en tant que poste informatique principal. Idem pour la vie professionnelle, qui est transformée, et le sera à tout jamais ! Bien évidemment, nous n'en sommes à ce stade qu'aux prémices de l'ordinateur portable tel que nous le connaissons aujourd'hui, mais le développement est en marche, pour le meilleur ! Il en va de même pour les tablettes et les smartphones, qui symbolisent l'informatique portable. Enfin, le virage des années 2000 marque l'évolution de la vente en ligne, et le web sert à bon nombre de professions, pour transférer des données importantes ! C'est à ce moment que le protocole sécurisé HTTPS est mis en place. mais si, vous savez, ces petits symboles qui, dans la barre de recherche, nous garantissent une sécurité optimale de la navigation ! Enfin, en 2005, l'écran plat fait son apparition, et donne à l'ordinateur des airs familiers ! En bref, en informatique, on peut le dire : merci l'an 2000 !

L'informatiques dans les années 2010

Résumer via IA :